Analisi Semantica: dalla matematica al SEO

L’analisi semantica è uno dei modelli più importanti introdotti da Google nel suo algoritmo di ricerca con il lancio dell’aggiornamento Humming Bird (2013). Con esso l’attenzione verso le parole chiave in se viene spostata piuttosto verso l’intero contenuto di una pagina del sito internet in relazione con tutti i contenuti del sito stesso.

L’analisi semantica è uno dei modelli più importanti introdotti da Google nel suo algoritmo di ricerca con il lancio dell’aggiornamento Humming Bird (2013). Con esso l’attenzione verso le parole chiave in se viene spostata piuttosto verso l’intero contenuto di una pagina del sito internet in relazione con tutti i contenuti del sito stesso.

Qualche giorno fa sono stato colpito positivamente da un articolo sulla ricerca semantica scritto da Federica Brancale, in cui l’autrice spiega l’evoluzione dell’analisi SEO in funzione dell’algoritmo sulla ricerca semantica, dandone una spiegazione tecnica, con cenni matematici chiari, fino a far comprendere come tutto ciò si riflette sulle tecniche di posizionamento sui motori di ricerca. Ne esce fuori il fatto che al giorno d’oggi è essenziale conoscere la logica dell’algoritmo semantico utilizzare al meglio le tecniche SEO. Ma andiamo con ordine, ed analizziamo passo passo ogni dettaglio.

BREVE INTRODUZIONE

Da qualche anno a questa parte la linea seguita da Google per la gestione delle informazioni è quella di fornire agli utenti risultati ti ricerca quanto più vicini alle informazioni effettivamente ricercate, nonchè informazioni utili, originali. Per raggiungere questo obiettivo è necessario un algoritmo in grado di riconoscere non solo singole parole (le parole chiave) bensì la loro connessione con l’intero contenuto in cui queste appaiono. In parole povere è essenziale saper leggere e comprendere tutto il contenuto, individuarne l’argomento trattato (il topic) e capire:

- qual è il reale argomento trattato;

- quali sono le parole che appaiono con più frequenza nel contenuto individuandone il topic;

- come è correlato l’argomento trattato con tutti i contenuti presenti sul sito internet;

- come sono correlate le parole che appaiono con più frequenza nel contenuto, con le parole che appaiono con maggior frequenza nell’intero sito.

Viene quindi effettuata un’analisi locale (del singolo contenuto) per poi essere analizzata a livello globale (l’intero sito). I risultati dell’analisi, poi, cercano di rispondere a queste domande:

- Quali sono le parole chiave del contenuto?

- Qual è, quindi, l’argomento trattato nel contenuto? (un articolo di un blog o una pagina statica del nostro sito internet);

- E’ un contenuto originale?

- Come si correla l’argomento del contenuto con il tema principale dell’intero sito internet?

Se con il nostro sito internet pubblicizziamo la nostra attività di esperti in elettronica, ma il contenuto tratta di tecniche SEO, è ovvio che siamo fuori tema in quanto il contenuto scritto ha poca coerenza con l’argomento principale del nostro sito.

Analisi

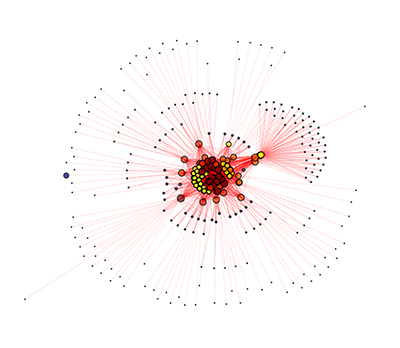

Dopo aver fatto questa analisi, vengono poi effettuate altre analisi relative ad aspetti più inerenti le tecniche SEO conosciute, come il posizionamento delle parole chiave nei heading (tag h1, h2, ecc…) nelle metadescription, analisi degli anchor text dei link, ecc… (puoi leggere il mio articolo sul SEO e fattori di ranking per approfondire alcuni di questi aspetti), per poi passare ad analizzare la connessione del nostro sito internet con il mondo esterno del web: qui però entriamo nell’ambito della teoria dei grafi, che tratterò in un prossimo articolo, ma se vuoi puoi leggere un approfondimento sul grafo delle reti scritto sul blog di Google.

LATENT SEMANTIC INDEX (LSI): LE PAROLE CHIAVE

Vediamo come l’algoritmo di Google valuta le parole chiave dai nostri contenuti. Questo è per me un argomento molto affascinante, perché da esperto in modelli matematici e numerici, mostra la mia visione sul fatto che la matematica è presente in ogni piccolo aspetto delle tecnologie che utilizziamo e che utilizzeremo in futuro.

Un indice importante nell’analisi semantica è il Latent Semantic Index, un indice che valuta la correlazione semantica di parole o piccole frasi, che seppur diverse, possono avere lo stesso significato e peso.

Per meglio capire l’importanza di questo indice facciamo alcuni esempi:

- la parola sito può avere molteplici significati, ma nel contesto globale di un sito di un webmaster può assumere il significato di sito internet, mentre nel contesto globale di un del sito di un archeologo assume il significato di sito archeologico.

- il periodo sito web, rispetto al periodo sito internet, contiene di diverso la parola web, così come siti internet e sito web sono due parole differenti (forma plurale rispetto al singolare). O ancora creazione siti internet è differente da realizzazione sito web, sia nella forma che nei termini utilizzati. Tuttavia hanno lo stesso significato semantico.

- Se questi termini elencati nel punto precedente appaiono in nel il mio sito internet e ne rappresentano le parole chiave, allora il contenuto stesso a livello semantico è coerente con il topic del mio sito internet.

Questa è una delle funzioni che svolge il Latent Semantic Index. Ma può fare ancora di più:

- Quante volte appare il periodo sito web nel contenuto scritto? quante varianti contiene (es. punto 2)?

- Appurato che la parola sito web in tutte le sue varianti è la parola chiave del contenuto, essa è una delle parole chiave del sito nella sua globalità?

PROCEDURA PER IL CALCOLO DEL LSI

Esporrò ora nel modo più semplice possibile la procedura semplificata per il calcolo di questo indice, così come esposta dalla bravissima Federica Brancale nel suo articolo sulla ricerca semantica, inserendo delle note di approfondimento matematiche per chi abbia voglia di leggerle).

- Viene analizzato il documento (pagina o articolo di un blog) raccogliendone tutte le parole;

- Vengono tolti avverbi, articoli, pronomi, aggettivi, ecc…

- Vengono calcolate le co-occorrenze (keyword density) in ogni contenuto del sito (ogni contenuto con le sue co-occorrenze può essere visto come un’equazione lineare, dove il fattore moltiplicativo di ogni variabile è la frequenza di ogni parla chiave);

- Vengono calcolate le co-occorrenze in tutti i contenuti del sito (topic density), in modo tale da avere il valore della parola chiave a livello globale;

- Viene creata una matrice in cui ogni riga rappresenta i dati di un contenuto (pagina o articolo) con le sue co-occorrenze, e viene messa in relazione con i dati globali del sito. Dal punto di vista matematico avremo un sistema di n equazioni lineari rappresentati in forma matriciale. Questa rappresentazione è classica dell’algebra lineare, in cui vengono rappresentati dati correlati in forma di equazioni, rappresentanti a loro volta vettori.

- MA A COSA SERVE TUTTO QUESTO? Questa rappresentazione dei dati del nostro contenuto e di tutti gli altri contenuti del sito serve per capire quanto le parole chiave del nostro contenuto si avvicinano globalmente a quelle del sito. Questo matematicamente viene fatto con tecniche numeriche come il metodo dei minimi quadrati, ossia quel metodo che sulla base di dati misurati ci dice con buona approssimazione come questi si approssimano al valore medio. Nel nostro caso il metodo dei minimi quadrati ci dice quanto le nostre parole con maggiore occorrenza si avvicinano al valore della parola chiave globale. L’approssimazione dipende dalla tecnica numerica che viene adottata e dalle condizioni iniziali che ci poniamo. Questo viene fatto adottando una tecnica numerica che fa uso della fattorizzazione di Matrici; in questo caso viene utilizzata la Decomposizione a Valori Singolari (SVD, dall’inglese Singular Decomposition Values).

- Dopo che questo metodo ha trovato le parole chiave più attinenti del nostro contenuto, queste vengono ripulite e analizzate sintatticamente, dandone un valore e un peso linguistico, tramite un algoritmo di stemming. Viene quindi calcolato il peso che la parola chiave ha localmente sul singolo contenuto e il peso che ha a livello globale.

- Quindi viene dato un peso al risultato finale: la parola che appare con più frequenza sull’intero sito avrà più peso rispetto a quella che appare con più frequenza sul singolo contenuto. Viene fatta quella che si chiama normalizzazione (in un certo senso serve a dare un risultato globale pesato).

- Quindi viene calcolato l’indice LSI moltiplicando: peso globale, peso locale e valore normalizzato.

INCIDENZA SULLE TECNICHE SEO

Appare quindi ovvio quale incidenza può avere sulle strategie SEO la conoscenza di questa metodologia. La scrittura di un contenuto quindi, oltre che essere originale e grammaticalmente corretta, deve anche focalizzare l’attenzione sul come i contenuti vengono scritti a livello di copywriting e di semantica, ponendo molta attenzione sulla ricerca delle parole chiave e sui suoi sinonimi che sono semanticamente correlati.

Per fare ciò ci sono diversi tools che vi invito a scoprire leggendo gli articoli di Federica Brancale.